Was ist Entropy (Entropie)?

Definition und Grundverständnis

In der Informatik bezeichnet Entropy (Entropie) ein maßgebliches Konzept zur Quantifizierung der Unvorhersagbarkeit und Unsicherheit von Daten oder Zuständen. Ursprünglich in der Thermodynamik eingeführt, wurde der Begriff von Claude Shannon in der modernen Informationstheorie formalisiert und beschreibt dort die mittlere Ungewissheit einer Zufallsquelle. In kryptographischen Systemen ist Entropie ein zentrales Maß, das angibt, wie schwer es ist, zufällige Werte wie Schlüssel, Nonces oder Initialisierungsvektoren vorauszusagen oder zu schätzen. Je höher die Entropie eines Systems oder einer Zufallsquelle ist, desto größer ist die Sicherheit und Unvorhersagbarkeit der erzeugten Daten.

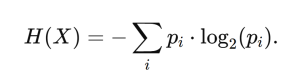

Technisch gesprochen wird Entropie in der Informationstheorie oft als der gewichtete Mittelwert der log-Wahrscheinlichkeiten von möglichen Ereignissen definiert. Für eine diskrete Zufallsvariable (X) mit Wahrscheinlichkeiten (p_i) ist die Shannon-Entropie:

Ein gleichverteiltes System mit N möglichen Zuständen hat dabei die maximale Entropie log2(N), was bedeutet, dass keine Vorhersage über den Ausgang möglich ist.

Wie unterscheidet sich Entropie von Randomness?

Ein wesentliches, aber häufig missverstandenes Konzept ist die Unterscheidung zwischen Entropie und Randomness (Zufälligkeit):

- Entropy beschreibt die Unsicherheit eines noch nicht eingetretenen Ergebnisses – also die theoretische Unvorhersagbarkeit, die ein System besitzt, bevor ein Datenwert generiert wird.

- Randomness hingegen bezieht sich auf die qualitative Bewertung dieser Unvorhersagbarkeit anhand historischer oder beobachteter Daten. Während Entropie als quantitative Größe messbar ist, ist Randomness eher ein qualitatives Merkmal, das nicht eindeutig messbar ist.

Diese Differenzierung ist besonders in der Kryptographie wichtig: Ein System kann eine große Entropie auf dem Papier besitzen, aber wenn seine Ausgaben in der Praxis deterministische oder systematische Muster aufweisen, besitzt es nicht die erwartete Zufälligkeit.

Entropie im Kontext der Informatik

In der Computerwelt bezeichnet Entropie meist die Realität der Unvorhersagbarkeit, die ein Betriebssystem oder eine Anwendung aus internen und externen Quellen sammelt und verwaltet, um sichere Zufallszahlen zu erzeugen. Solche Zufallszahlen werden in vielen sicherheitskritischen Bereichen benötigt:

- Schlüsselgenerierung (z. B. asymmetrische Schlüssel)

- Session-IDs und Nonces

- Initialisierungsvektoren für Blockchiffren

- Protokoll-Randomisierung

Betriebssysteme wie Linux sammeln Entropie aus chaotischen, nicht deterministischen Ereignissen – etwa Tastatur- oder Maus-Interrupts, Netzwerkpaket-Timing oder Hardware-Rauschquellen – und fügen diese Werte in einen Entropie-Pool ein, der von Systemprozessen wie /dev/random oder /dev/urandom abgefragt werden kann.

Entropie-Erzeugung und Entropie-Konsum

Entropiequellen

- Hardware-RNGs: spezifische Hardwaremodule zur Erzeugung physikalisch basierter Zufallswerte.

- Betriebssysteminterne Ereignisse: Interrupts, Netzwerk-Timings oder Benutzerinteraktionen.

- Externe Sensoren: Bei spezialisierten Systemen können zusätzliche Sensoren zur Entropieproduktion eingesetzt werden.

Entropie-Pool

Betriebssysteme verwalten eine interne Entropie-Sammlung („Pool“), die die aktuelle verfügbare Menge an ungegliederten, nicht deterministischen Bits repräsentiert. /dev/random liefert Zufallswerte mit hoher Entropie und blockiert bei Entropiemangel, während /dev/urandom Werte ohne Blockierung erzeugt, jedoch potenziell mit weniger garantierter Entropie.

Verbrauch und Management

Anwendungen wie OpenSSL greifen auf diese Entropie zu, indem sie ihre internen Pseudo-Random-Number-Generatoren (PRNGs) einmalig mit Entropie füttern und dann deterministisch fortfahren. Wird dabei zu wenig echte Entropie verwendet, kann dies die resultierende Sicherheit erheblich schwächen. Beispiele aus der Praxis zeigen, dass schlechte Entropieversorgung zu leicht angreifbaren Schlüsseln führen kann, wie etwa beim Debian OpenSSL PRNG-Debakel.

Bedeutung der Entropie für Sicherheit und Kryptographie

In kryptographischen Systemen ist hohe Entropie eine notwendige Bedingung für Sicherheit. Je höher die Entropie der verwendeten Daten, desto schwieriger wird es für einen Angreifer, diese Werte vorherzusagen oder durch Brute-Force-Angriffe zu rekonstruieren. Gleichzeitig ist das Messen der realen Entropie in echten Daten schwierig – es gibt keine universell korrekte Messmethode, und selbst standardisierte Tests wie jene der NIST können Entropie unterschätzen.

Ein kryptographischer Schlüssel mit n Bits Entropie hat theoretisch n2 mögliche Zustände. Nur wenn diese Zustände gleichverteilt und unabhängig sind, entspricht die praktische Sicherheit genau dieser theoretischen Entropiemessung.

Grenzen und Bewertung von Entropy

- Messbarkeit: Absolute Entropiemessung im realen Datenkontext bleibt schwierig.

- IT-Praxis: Viele Systeme nutzen PRNGs, die deterministisch arbeiten; die Qualität hängt hier stark von der Initialisierung mit ausreichend echter Entropie ab.

- Lifecycle-Sicht: Entropie unterliegt einem Lebenszyklus aus Generierung, Pooling, Verbrauch und möglicher Erschöpfung; effizientes Management ist für Sicherheit und Systemstabilität entscheidend.

Definition der Entropy nach ISAQB

Das International Software Architecture Qualification Board (ISAQB) definiert den Begriff “Entropy” wie folgt:

Unter Entropy versteht man “

In information theory defined as “amount of information” a message has o

“unpredictability of information content”. The entropy of a cryptosystem i

measured by the size of the keyspace. Larger keyspaces have an increase

entropy and if not flawed by the algorithm itself, harder to break than smalle

ones

For secure cryptographic operations it is mandatory to not only use rando

values as input, they should have also a high entropy. The creation of hig

entropy on a computer system is non-trivial and can affect the performance of

system.See 11.1 Information Theory of Schneier-1996 and Whitewood Inc. on “Understanding and Managing Entropy” or SANS “Randomness and Entropy – An Introduction”.

Category: Security

Wenn Sie ähnliche Fachbegriffe wie Entropy nachschlagen müssen, schauen Sie doch einfach in unserm umfangreichen Glossar nach. Oder durchsuchen Sie unser Wörterbuch: